O que você está procurando?

Redes de IA

Maximize o desempenho do data center de IA.

Otimize o desempenho e a eficiência da rede de IA

Acelere as implantações de data center de IA, valide o desempenho do SmartNIC e teste a pressão dos componentes de rede. Use emuladores de tráfego do mundo real para rastrear uma série de métricas de IA padrão do setor, como o tempo de conclusão do trabalho e a largura de banda de comunicação coletiva, em tempo real. Avalie o desempenho da rede de IA, detecte gargalos e otimize a distribuição da carga de trabalho de IA com ferramentas de teste de rede otimizadas para IA, incluindo emuladores de carga de trabalho de IA, geradores de tráfego de rede distribuído e emuladores de tráfego de rede.

Tudo o que você precisa saber sobre redes de IA

Juniper constrói redes de IA de próxima geração com a Keysight

Descubra como a Juniper Networks fez uma parceria com a Keysight para criar infraestrutura de rede para redes de IA. Saiba como as ferramentas de emulação de rede da Keysight ajudaram a Juniper a testar e validar seus produtos em relação às demandas do mundo real dos data centers de IA.

5 estratégias para otimizar e dimensionar os data centers de IA

A IA está transformando os setores e impulsionando a inovação. No entanto, padrões de tráfego exclusivos, cargas de trabalho dinâmicas e pressões implacáveis de desempenho podem transformar até mesmo as menores questões em problemas críticos.

Leia este eBook para descobrir cinco soluções práticas para otimizar o desempenho do data center de IA para aplicativos modernos.

Melhorando a escalabilidade em clusters de data center de IA

Sua infraestrutura de rede pode ser dimensionada para lidar com as cargas de trabalho de treinamento de IA complexas e de alto tráfego? Este white paper se aprofunda no dimensionamento de clusters de data center de IA, identifica os desafios críticos da rede e explica como garantir redes escaláveis e confiáveis para as ambições de IA da sua organização.

Bootcamp de rede de IA

Junte-se aos engenheiros da Keysight para um mergulho profundo no mundo dos testes de redes de IA e validação de implantações de data center de IA. Ao final deste curso, você obterá os insights - e a confiança - necessários para assumir o controle desse novo paradigma de rede inovador e em rápida mudança.

Benchmarking de operações coletivas

A medição ou o benchmarking do desempenho da rede em um cluster de IA pode ajudar as organizações a identificar oportunidades de otimizar e melhorar o rendimento geral sem custos adicionais de hardware. Este white paper explica a operação dos coletivos de IA, define a terminologia e analisa as métricas mais comuns associadas ao benchmarking de redes de IA.

Validar a Ethernet sem perdas em velocidades de até 1,6T

Fique à frente das demandas de desempenho acelerado, garantindo a transmissão confiável de dados em redes de IA/ML e de computação de alto desempenho.

Teste de pressão do equipamento de rede de IA em emulações de carga de trabalho de IA

Reduza a necessidade de configurações dispendiosas de laboratório baseadas em GPU com geradores de tráfego de alta densidade que emulam o comportamento da carga de trabalho de IA para otimizar o desempenho e a eficiência.

Veja como os parâmetros de rede específicos da IA afetam o desempenho

Escolha entre uma variedade de modelos de tráfego e perfis de carga de trabalho para simplificar o benchmarking e testar o desempenho da rede no nível do componente e do sistema.

Explore soluções para redes de IA

Otimize a infraestrutura de IA com o KAI Data Center Builder

Avalie o desempenho do data center de IA com fidelidade inigualável. O KAI Data Center Builder emula a combinação de comunicações coletivas e algoritmos usados para criar um grande modelo de aprendizado (LLM), facilitando a validação da infraestrutura de rede e dos fabrics de IA por meio de testes em todo o sistema.

Maximize a confiabilidade e o desempenho da Ethernet 1.6T

Teste produtos Ethernet de ponta para interconexões de IA e redes de data center. Com suporte para teste de camada física (L1) e de protocolo (L2-3), o Keysight Interconnect and Network Performance Tester 1600GE oferece cobertura de teste inigualável para interconexões de cabos ópticos e ativos, switches de rede e redes de IA.

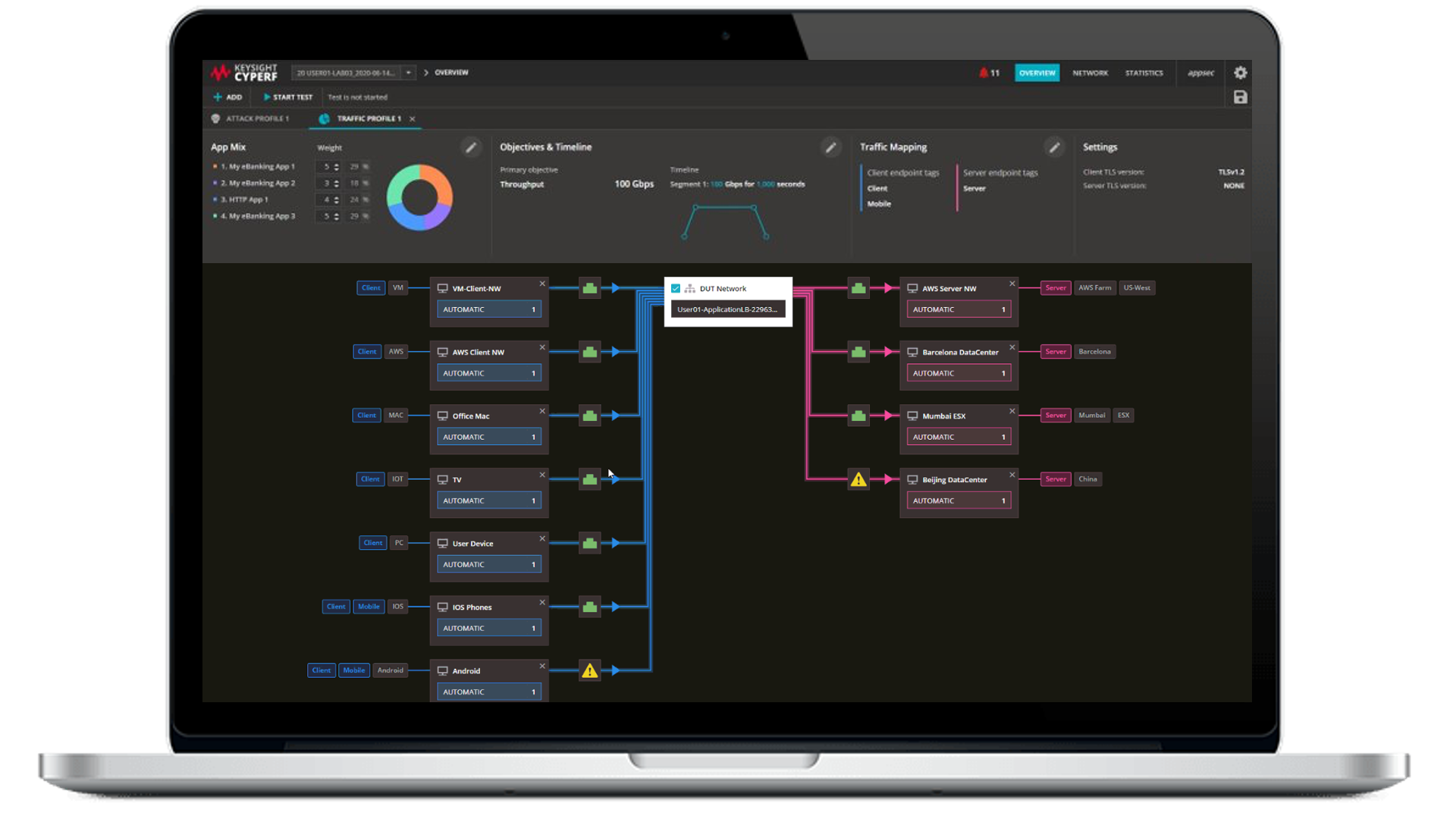

Valide a infraestrutura de SmartNICs e LLM com o CyPerf

Faça testes de pressão em equipamentos de rede de alto desempenho contra emulações de tráfego intensivas em computação e nativas de IA e cenários de teste. O CyPerf da Keysight facilita a avaliação do desempenho, da escalabilidade e da estabilidade do sistema por meio de benchmarking, simulação de tráfego do mundo real e testes em alta escala.

Proteja os LLMs contra ataques avançados com o BreakingPoint

Proteja grandes modelos de linguagem contra o tipo mais prevalente de ataque cibernético que afeta as redes de IA: ataques de injeção imediata. Uma ferramenta avançada de segurança de rede e teste de aplicativos, o Keysight BreakingPoint pode validar a segurança, a estabilidade e o desempenho de redes de IA - e o equipamento de rede que as alimenta.

Perspectiva executiva: Soluções de IA da Keysight

Ouça Ram Periakaruppan, vice-presidente e gerente geral de negócios de aplicativos de rede e segurança da Keysight Technologies, discutir os principais desafios enfrentados pelos data centers de IA, como otimizar o desempenho e a eficiência da IA e como a Keysight está ajudando com o portfólio de soluções de data center prontas para IA da Keysight.

Configurações de teste para validação de redes de IA

Teste as redes de data center de IA

Emule cargas de trabalho de IA para fazer benchmark de equipamentos de rede e validar telas de IA/ML.

Validação de interconexões Ethernet

Garanta a transmissão de dados de alta qualidade e a correção de erros testando a confiabilidade e o desempenho.

Emular cargas de trabalho do data center de IA

Otimize a infraestrutura para o desempenho do treinamento em IA com uma metodologia de teste consistente e dimensionável.

Saiba mais sobre as redes de IA

Perguntas frequentes: Redes de IA

Em uma rede tradicional, o tipo e o tamanho da carga de trabalho variam, o tráfego é distribuído entre diferentes conexões, cresce proporcionalmente ao número de usuários e os pacotes atrasados ou descartados não costumam causar problemas significativos. Em uma rede de IA, todas as GPUs trabalham no mesmo problema, criando um modelo de linguagem grande (LLM). As cargas de trabalho para criar um LLM exigiam que grandes quantidades de dados fossem compartilhadas entre as GPUs sem que houvesse queda de pacotes ou congestionamento. Como as GPUs estão todas trabalhando no mesmo problema, elas concluem uma tarefa quando a última GPU termina o processamento. Qualquer atraso no fornecimento de dados a uma GPU significa que toda a carga de trabalho está atrasada.

A otimização de uma rede de IA é diferente da otimização de uma rede tradicional de data center. As redes de IA são executadas quase na capacidade e precisam ser sem perdas para maximizar a utilização da GPU. Diferentes mecanismos de congestionamento estão disponíveis com várias configurações. A execução de cargas de trabalho de IA em um ambiente de laboratório com ferramentas de benchmarking fornece um caminho para encontrar as configurações e definições ideais que podem ser aplicadas aos ambientes de produção.

Em uma rede de IA, as GPUs trabalham no mesmo problema, concluindo uma tarefa somente quando a última GPU recebe os dados de que precisa e termina o processamento. Uma das principais medidas de desempenho de uma rede de IA é a latência de cauda - os fluxos com os tempos de conclusão mais longos. A medida é chamada de P95 - o tempo de conclusão dos cinco por cento mais lentos dos fluxos de rede.

RDMA é um acrônimo que significa Remote Direct Memory Access. O RDMA permite que as GPUs transfiram dados entre si em um data center de IA com envolvimento mínimo da CPU e das pilhas de rede. Isso permite comunicações de baixa latência e alta taxa de transferência em um data center de IA. As placas de interface de rede habilitadas para RDMA em um servidor se conectam a switches habilitados para RDMA para permitir a comunicação de alta velocidade entre GPUs.

A Ultra Ethernet (UE) adiciona recursos à Ethernet para fornecer uma rede rápida, altamente dimensionável e de baixa latência para requisitos de IA e computação de alto desempenho. A pulverização de pacotes permite que os fluxos usem mais de um caminho para um destino, possibilitando um melhor balanceamento de carga em toda a rede. A ordenação flexível permite que os pacotes cheguem ao destino fora de ordem. O controle de congestionamento baseado no receptor baseia-se nos mecanismos existentes de controle de congestionamento baseados no remetente para melhorar o congestionamento in-cast que ocorre com coletivos de IA, como o All-to-All. A telemetria aprimorada permite tempos de sinalização do plano de controle mais rápidos, melhorando a resposta a eventos de congestionamento. O UE é interoperável com os switches Ethernet de data center existentes, mas será executado com mais eficiência - com maior utilização da rede e latência reduzida - usando switches e placas de interface de rede baseados em UEC.

A movimentação de dados entre GPUs é chamada de Operação Coletiva. Há vários tipos diferentes, dependendo do local inicial e final dos dados e se há necessidade de executar uma matemática nos dados durante o processo. Os tipos comumente usados são Broadcast and Gather, ReduceScatter, AllGather, AllReduce e AlltoAll. A presença da palavra-chave "reduce" no nome da operação significa que essa operação executa cálculos nos dados. Uma operação coletiva pode ser implementada usando qualquer número de algoritmos. Os algoritmos conhecidos para AllReduce são Unidirectional e Bidirectional Ring, Double Binary Tree e Halving-Doubling. Cada um deles demonstra um desempenho melhor ou pior, dependendo do número de GPUs e de como elas estão interconectadas.

Deseja ajuda ou tem dúvidas?