Können wir Ihnen behilflich sein?

AI-Netzwerke

Maximieren Sie die Leistung von AI-Rechenzentren.

Optimieren Sie die Leistung und Effizienz von AI-Netzwerken

Beschleunigen Sie die Bereitstellung von KI-Rechenzentren, validieren Sie die SmartNIC-Leistung und testen Sie Netzwerkkomponenten unter Druck. Verwenden Sie Emulatoren für realen Datenverkehr, um eine Reihe von KI-Standardmetriken in Echtzeit zu verfolgen, z. B. die Dauer der Auftragsabwicklung und die kollektive Kommunikationsbandbreite. Benchmarking der KI-Netzwerkleistung, Erkennung von Engpässen und Optimierung der KI-Workload-Verteilung mit KI-optimierten Netzwerktesttools, einschließlich KI-Workload-Emulatoren, Generatoren für verteilten Netzwerkverkehr und Emulatoren für den Netzwerkverkehr.

Alles, was Sie über AI-Netzwerke wissen müssen

Juniper baut AI-Netzwerke der nächsten Generation mit Keysight auf

Erfahren Sie, wie Juniper Networks in Zusammenarbeit mit Keysight eine Netzwerkinfrastruktur für KI-Netzwerke aufgebaut hat. Erfahren Sie, wie die Netzwerkemulations-Tools von Keysight Juniper beim Testen und Validieren ihrer Produkte im Hinblick auf die realen Anforderungen von KI-Rechenzentren unterstützt haben.

5 Strategien zur Optimierung und Skalierung von KI-Rechenzentren

KI verändert die Industrie und treibt Innovationen voran. Einzigartige Datenverkehrsmuster, dynamische Workloads und unerbittlicher Leistungsdruck können jedoch selbst kleinste Probleme zu kritischen Problemen auswachsen lassen.

In diesem eBook finden Sie fünf praktische Lösungen zur Optimierung der KI-Rechenzentrumsleistung für moderne Anwendungen.

Verbesserung der Skalierbarkeit in KI-Rechenzentrums-Clustern

Kann Ihre Netzwerkinfrastruktur skaliert werden, um die komplexen, hochfrequentierten KI-Trainings-Workloads zu bewältigen? Dies white paper befasst sich mit der Skalierung von KI-Rechenzentrumsclustern, identifiziert kritische Netzwerkherausforderungen und erklärt, wie Sie skalierbare und zuverlässige Netzwerke für die KI-Ambitionen Ihres Unternehmens sicherstellen.

AI Networking Bootcamp

Tauchen Sie gemeinsam mit Keysight-Ingenieuren tief in die Welt des Testens von KI-Netzwerken und der Validierung von KI-Rechenzentrumsimplementierungen ein. Am Ende dieses Kurses werden Sie das nötige Wissen - und Vertrauen - erlangen, um dieses sich schnell verändernde, innovative neue Netzwerkparadigma zu beherrschen.

Benchmarking kollektiver Maßnahmen

Durch die Messung oder das Benchmarking der Netzwerkleistung in einem KI-Cluster können Unternehmen Möglichkeiten zur Optimierung und Verbesserung des Gesamtdurchsatzes ohne zusätzliche Hardwarekosten identifizieren. Dies white paper erklärt die Funktionsweise von KI-Kollektiven, definiert die Terminologie und überprüft die gängigsten Metriken im Zusammenhang mit dem Benchmarking von KI-Netzwerken.

Validierung von verlustfreiem Ethernet bei Geschwindigkeiten bis zu 1.6T

Bleiben Sie den steigenden Leistungsanforderungen voraus, indem Sie eine zuverlässige Datenübertragung in KI/ML- und High-Performance-Computing-Netzwerken sicherstellen.

Belastungstests für KI-Netzwerkgeräte anhand von KI-Workload-Emulationen

Reduzieren Sie den Bedarf an kostspieligen GPU-basierten Labor-Setups mit High-Density-Traffic-Generatoren, die das KI-Workload-Verhalten emulieren, um Leistung und Effizienz zu optimieren.

Sehen Sie, wie AI-spezifische Netzwerkparameter die Leistung beeinflussen

Wählen Sie aus einer Reihe von Verkehrsmodellen und Arbeitslastprofilen, um das Benchmarking zu vereinfachen und die Netzwerkleistung auf Komponenten- und Systemebene zu testen.

Entdecken Sie Lösungen für KI-Netzwerke

Optimieren Sie Ihre KI-Infrastruktur mit KAI Data Center Builder

Testen Sie die Leistung von KI-Rechenzentren mit unvergleichlicher Genauigkeit. KAI Data Center Builder emuliert die Kombination aus kollektiver Kommunikation und Algorithmen, die zum Aufbau eines großen Lernmodells (LLM) verwendet werden, und erleichtert so die Validierung von Netzwerkinfrastruktur und KI-Fabrics durch systemweite Tests.

Maximieren 1.6T Ethernet-Zuverlässigkeit und -Leistung

Testen Sie modernste Ethernet-Produkte für AI-Verbindungen und Rechenzentrumsnetzwerke. Mit Unterstützung für Tests auf der physikalischen (L1) und der Protokollschicht (L2-3) bietet der Keysight Interconnect and Network Performance Tester 1600GE eine unübertroffene Testabdeckung für optische und aktive Kabelverbindungen, Netzwerk-Switches und AI-Netzwerke.

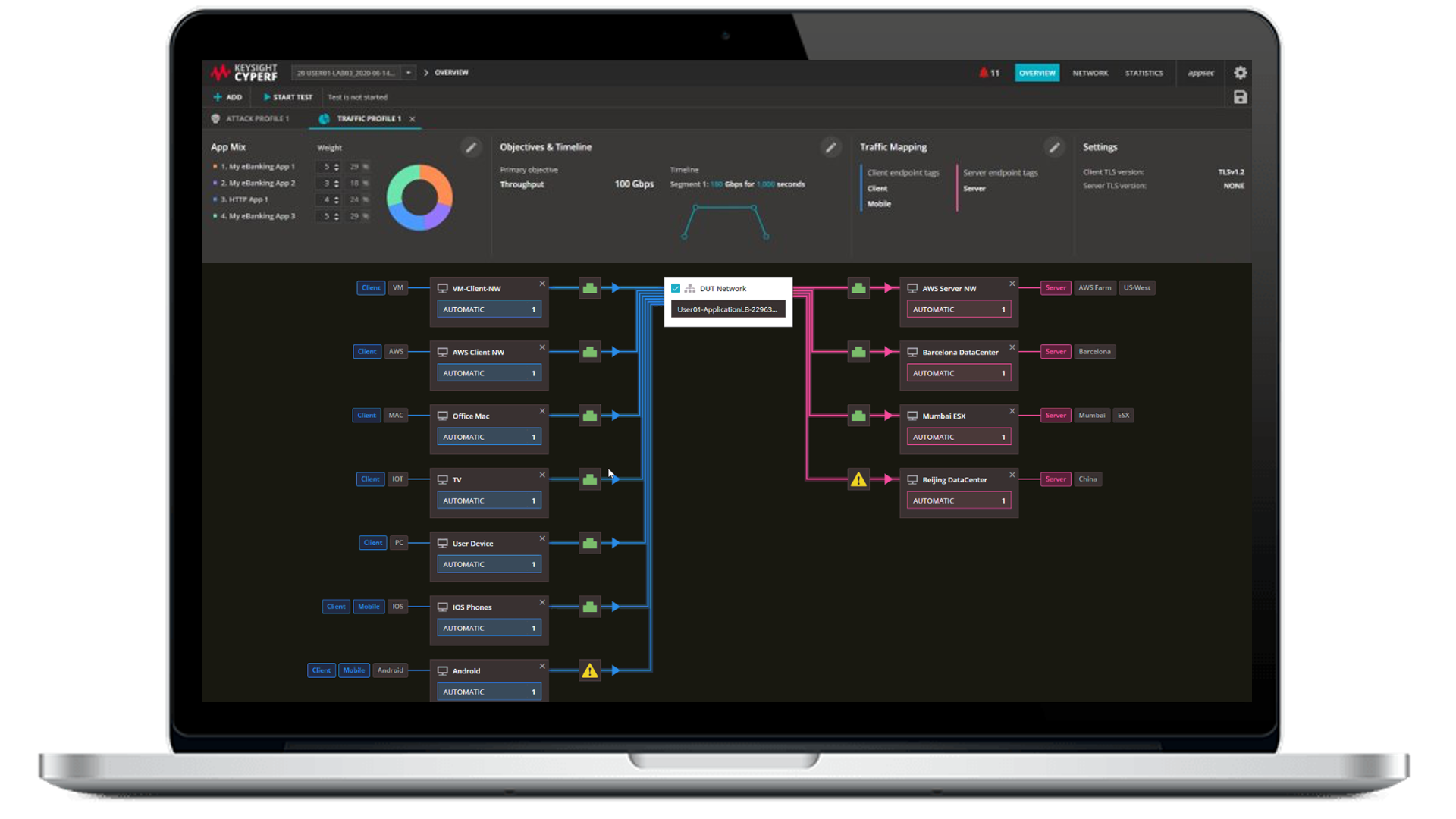

Validierung von SmartNICs und LLM-Infrastruktur mit CyPerf

Führen Sie Drucktests von Hochleistungsnetzwerkgeräten mit rechenintensiven, KI-nativen Verkehrsemulationen und Testszenarien durch. Keysight CyPerf erleichtert die Bewertung der Systemleistung, Skalierbarkeit und Stabilität durch Benchmarking, reale Verkehrssimulationen und Tests im großen Maßstab.

Schutz von LLMs vor fortgeschrittenen Angriffen mit BreakingPoint

Schützen Sie große Sprachmodelle vor der häufigsten Art von Cyberangriffen auf KI-Netzwerke: Prompt-Injection-Strikes. Als fortschrittliches Tool für Netzwerksicherheit und Anwendungstests kann Keysight BreakingPoint die Sicherheit, Stabilität und Leistung von KI-Netzwerken - und der Netzwerkausrüstung, die sie betreibt - validieren.

Perspektive für Führungskräfte: Keysight AI-Lösungen

Hören Sie Ram Periakaruppan, Vice President und General Manager des Geschäftsbereichs Network Applications and Security bei Keysight Technologies, zu den wichtigsten Herausforderungen für KI-Rechenzentren, zur Optimierung der KI-Leistung und -Effizienz und zu den Möglichkeiten, die Keysight mit dem Keysight AI-Portfolio an KI-fähigen Rechenzentrumslösungen bietet.

Testaufbauten zur Validierung von AI-Netzwerken

Test AI Data Center Netzwerke

Emulation von KI-Workloads zum Benchmarking von Netzwerkgeräten und zur Validierung von KI/ML-Fabrics.

Validierung von Ethernet-Verbindungen

Sicherstellung einer hochwertigen Datenübertragung und Fehlerkorrektur durch Prüfung der Zuverlässigkeit und Leistung.

Emulation von AI-Rechenzentrums-Workloads

Optimieren Sie die Infrastruktur für die KI-Trainingsleistung mit einer konsistenten und skalierbaren Testmethodik.

Erfahren Sie mehr über AI Networks

Häufig gestellte Fragen: KI-Netzwerke

In einem herkömmlichen Netzwerk variieren Art und Umfang der Arbeitslast, der Datenverkehr verteilt sich auf verschiedene Verbindungen, wächst proportional zur Benutzeranzahl, und verzögerte oder verlorene Pakete verursachen in der Regel keine nennenswerten Probleme. In einem KI-Netzwerk arbeiten alle GPUs an derselben Problemstellung und erstellen ein großes Sprachmodell (LLM). Die Arbeitslasten zum Erstellen eines LLM erfordern den Austausch riesiger Datenmengen zwischen den GPUs, ohne dass Pakete verloren gehen oder es zu Überlastungen kommt. Da alle GPUs an derselben Problemstellung arbeiten, schließen sie eine Aufgabe ab, sobald die letzte GPU die Verarbeitung abgeschlossen hat. Jede Verzögerung bei der Datenübertragung an eine GPU bedeutet eine Verzögerung der gesamten Arbeitslast.

Die Optimierung eines KI-Netzwerks unterscheidet sich von der Optimierung eines herkömmlichen Rechenzentrumsnetzwerks. KI-Netzwerke laufen nahezu an ihrer Kapazitätsgrenze und müssen verlustfrei sein, um die GPU-Auslastung zu maximieren. Es stehen verschiedene Überlastungsmechanismen mit unterschiedlichen Einstellungen zur Verfügung. Die Ausführung von KI-Workloads in einer Laborumgebung mit Benchmarking-Tools bietet einen Weg, optimale Konfigurationen und Einstellungen zu finden, die dann in Produktionsumgebungen angewendet werden können.

In einem KI-Netzwerk arbeiten GPUs an demselben Problem: Sie schließen eine Aufgabe erst ab, wenn die letzte GPU die benötigten Daten erhält und die Verarbeitung abgeschlossen hat. Ein wichtiger Messwert für die Leistung eines KI-Netzwerks ist die sogenannte Tail-Latenz – die Datenflüsse mit den längsten Abschlusszeiten. Diese Messung heißt P95 und beschreibt die Abschlusszeit für die langsamsten fünf Prozent der Netzwerkdatenflüsse.

RDMA ist ein Akronym für Remote Direct Memory Access. RDMA ermöglicht GPUs die Datenübertragung untereinander in einem KI-Rechenzentrum mit minimaler Einbindung der CPU und der Netzwerk-Stacks. Dies ermöglicht eine Kommunikation mit geringer Latenz und hohem Durchsatz in einem KI-Rechenzentrum. RDMA-fähige Netzwerkkarten in einem Server verbinden sich mit RDMA-fähigen Switches, um eine Hochgeschwindigkeitskommunikation zwischen GPUs zu ermöglichen.

Ultra Ethernet (UE) erweitert Ethernet um Funktionen, die ein schnelles, hoch skalierbares Netzwerk mit geringer Latenz für KI- und Hochleistungsrechneranforderungen bereitstellen. Packet Spraying ermöglicht es Datenströmen, mehrere Pfade zu einem Ziel zu nutzen, was zu einer verbesserten Lastverteilung im Netzwerk führt. Durch flexible Sortierung können Pakete ungeordnet am Ziel ankommen. Die empfängerbasierte Überlastungskontrolle baut auf bestehenden senderbasierten Überlastungskontrollmechanismen auf, um In-Cast-Überlastungen zu reduzieren, die bei KI-Kollektiven wie All-to-All auftreten. Verbesserte Telemetrie ermöglicht schnellere Signalisierungszeiten auf der Steuerungsebene und verbessert so die Reaktion auf Überlastungsereignisse. UE ist mit bestehenden Ethernet-Switches in Rechenzentren kompatibel, läuft aber mit UEC-basierten Switches und Netzwerkkarten effizienter – mit höherer Netzwerkauslastung und reduzierter Tail-Latenz.

Die Datenübertragung zwischen GPUs wird als kollektive Operation bezeichnet. Es gibt verschiedene Typen, abhängig vom ursprünglichen und endgültigen Speicherort der Daten und davon, ob während des Vorgangs eine mathematische Berechnung der Daten erforderlich ist. Häufig verwendete Typen sind Broadcast and Gather, ReduceScatter, AllGather, AllReduce und AlltoAll. Das Schlüsselwort „reduce“ im Namen der Operation bedeutet, dass diese Berechnungen mit den Daten durchführt. Eine kollektive Operation kann mit einer beliebigen Anzahl von Algorithmen implementiert werden. Bekannte Algorithmen für AllReduce sind Unidirektionaler und Bidirektionaler Ring, Doppelter Binärbaum und Halbierung-Verdoppelung. Jeder dieser Algorithmen zeigt eine bessere oder schlechtere Leistung, abhängig von der Anzahl der GPUs und deren Vernetzung.

Sie brauchen Hilfe oder haben Fragen?